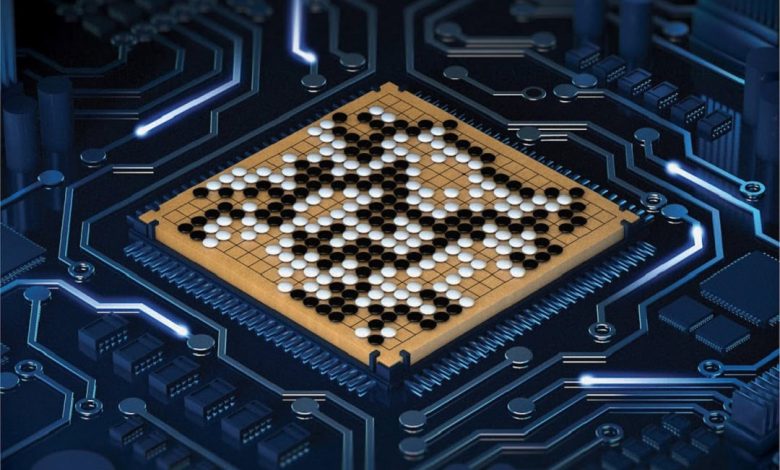

آشنایی با آلفاگو گوگل AlphaGo

آلفاگو AlphaGo یکی از برجستهترین دستاوردهای هوش مصنوعی در دهههای اخیر است که توسط شرکت دیپمایند (DeepMind) توسعه یافت. این برنامه با پیروزی بر قهرمانان جهان در بازی پیچیده گو (Go)، نهتنها تواناییهای هوش مصنوعی را به نمایش گذاشت، بلکه درک ما از یادگیری ماشینی و پتانسیلهای آن را متحول کرد. به گزارش ابرار صنعتی، آلفاگو با ترکیب یادگیری عمیق، یادگیری تقویتی و جستجوی پیشرفته، استاندارد جدیدی در توسعه سیستمهای هوشمند ایجاد کرد.

معرفی دیپمایند آلفاگو

آلفاگو یک برنامه هوش مصنوعی است که توسط دیپمایند، یک شرکت تحقیقاتی بریتانیایی که در سال 2014 توسط گوگل خریداری شد، برای بازی گو توسعه یافت. گو یک بازی باستانی چینی است که به دلیل پیچیدگی استراتژیک و تعداد بالای حالات ممکن (10 به توان 170) بهعنوان یکی از چالشهای بزرگ هوش مصنوعی شناخته میشود. آلفاگو از ترکیب شبکههای عصبی عمیق و الگوریتمهای جستجوی پیشرفته استفاده کرد تا در سال 2016 با پیروزی 4 بر 1 مقابل لی سدول، یکی از بهترین بازیکنان گو در جهان، تاریخساز شود. این موفقیت نهتنها تواناییهای هوش مصنوعی را نشان داد، بلکه الهامبخش پیشرفتهای بعدی در زمینههای علمی و صنعتی شد.

تاریخچه پروژه آلفاگو

پروژه آلفاگو در حدود سال 2014 در دیپمایند آغاز شد، زمانی که دمیس حسابیس (Demis Hassabis) و دیوید سیلور (David Silver) تصمیم گرفتند چالشی بزرگتر از شطرنج را برای هوش مصنوعی هدف قرار دهند. برخلاف شطرنج، که در سال 1997 توسط دیپ بلو (Deep Blue) شرکت IBM فتح شده بود، گو به دلیل پیچیدگیهایش برای دههها غیرقابل نفوذ برای هوش مصنوعی باقی مانده بود. در اکتبر 2015، آلفاگو اولین موفقیت خود را با پیروزی 5 بر 0 مقابل فان هوی (Fan Hui)، قهرمان سه دوره اروپا، به دست آورد. این پیروزی اولین باری بود که یک برنامه کامپیوتری یک بازیکن حرفهای گو را بدون هندیکپ شکست داد. در مارس 2016، آلفاگو با پیروزی مقابل لی سدول به شهرت جهانی رسید و در سال 2017، نسخه پیشرفتهتر آن، آلفاگو مستر (Master)، کی جیه (Ke Jie)، بهترین بازیکن جهان در آن زمان، را شکست داد.

دلایل انتخاب بازی گو برای توسعه هوش مصنوعی

بازی گو به دلیل پیچیدگی بینظیرش بهعنوان یک آزمایشگاه ایدهآل برای توسعه هوش مصنوعی انتخاب شد. این بازی با تخته 19×19 و تعداد حالات ممکن بیشتر از تعداد اتمهای موجود در جهان قابل مشاهده (10 به توان 170 در مقابل 10 به توان 80)، چالشی بزرگتر از شطرنج ارائه میداد. برخلاف شطرنج، که الگوریتمهای جستجوی سنتی مانند alpha-beta pruning میتوانستند عملکرد خوبی داشته باشند، گو نیازمند خلاقیت و شهود انسانی بود که برای ماشینها دشوار بود. دیپمایند گو را انتخاب کرد تا تواناییهای یادگیری عمیق و یادگیری تقویتی را در حل مسائل پیچیده و غیرقابل پیشبینی آزمایش کند، با این هدف که این فناوریها به حوزههای دیگر مانند پزشکی و علوم مواد منتقل شوند.

داستان توسعه آلفاگو از ایده تا موفقیت جهانی

توسعه آلفاگو از یک ایده بلندپروازانه در دیپمایند آغاز شد، زمانی که محققان تصمیم گرفتند سیستمی بسازند که بتواند بدون تکیه بر دانش انسانی قبلی، استراتژیهای پیچیده را یاد بگیرد. در مراحل اولیه، آلفاگو با استفاده از دادههای 30 میلیون حرکت از بازیهای انسانی آموزش دید. سپس، با استفاده از یادگیری تقویتی، سیستم با بازی مقابل نسخههای مختلف خود بهبود یافت. این فرآیند خودآموزی، آلفاگو را قادر ساخت تا استراتژیهای نوآورانهای ابداع کند که حتی بازیکنان حرفهای را شگفتزده کرد. موفقیت در برابر فان هوی در سال 2015، نقطه عطفی بود که توجه جهانی را جلب کرد. پیروزی مقابل لی سدول در سال 2016، که بیش از 200 میلیون نفر آن را تماشا کردند، آلفاگو را به نمادی از پتانسیل هوش مصنوعی تبدیل کرد.

مفاهیم اولیه هوش مصنوعی مورد استفاده در آلفاگو

آلفاگو از چندین مفهوم کلیدی هوش مصنوعی بهره میبرد:

- یادگیری عمیق (Deep Learning)

- یادگیری تقویتی (Reinforcement Learning)

- جستجوی درخت مونتکارلو (Monte Carlo Tree Search – MCTS)

یادگیری عمیق به آلفاگو امکان تحلیل الگوهای پیچیده در دادههای بازی را داد. یادگیری تقویتی به سیستم اجازه داد تا از طریق آزمونوخطا استراتژیهای بهتری کشف کند. جستجوی درخت مونتکارلو برای انتخاب بهترین حرکتها در میان تعداد عظیم حالات ممکن استفاده شد. این ترکیب، آلفاگو را قادر ساخت تا نهتنها حرکات انسانی را تقلید کند، بلکه راهحلهای خلاقانهای ارائه دهد که پیشتر دیده نشده بودند.

یادگیری عمیق در آلفاگو

یادگیری عمیق در آلفاگو از طریق شبکههای عصبی عمیق (Deep Neural Networks) پیادهسازی شد که شامل دو شبکه اصلی بود: شبکه سیاست (Policy Network) و شبکه ارزش (Value Network). شبکه سیاست احتمال انتخاب هر حرکت را پیشبینی میکرد، در حالی که شبکه ارزش شانس پیروزی در یک موقعیت خاص را ارزیابی میکرد. این شبکهها ابتدا با دادههای بازیهای انسانی آموزش دیدند تا الگوهای استراتژیک را یاد بگیرند. سپس، با استفاده از یادگیری تقویتی، آلفاگو با بازی مقابل خود بهبود یافت و استراتژیهای جدیدی ابداع کرد. این رویکرد یادگیری عمیق به آلفاگو امکان داد تا تصمیمگیری شهودی مشابه انسانها داشته باشد.

یادگیری تقویتی و نقش آن در عملکرد آلفاگو

یادگیری تقویتی (Reinforcement Learning) نقش محوری در موفقیت آلفاگو داشت. در این روش، آلفاگو با انجام میلیونها بازی مقابل نسخههای مختلف خود، بازخوردهایی در قالب پاداش یا جریمه دریافت میکرد. این فرآیند به سیستم اجازه داد تا بهتدریج استراتژیهای بهینهتری کشف کند. برخلاف روشهای سنتی که به قوانین ثابت یا دادههای انسانی وابسته بودند، یادگیری تقویتی به آلفاگو امکان داد تا مستقل از دانش انسانی، خلاقیت و نوآوری نشان دهد. این رویکرد بهویژه در نسخه آلفاگو زیرو (AlphaGo Zero) برجسته بود که بدون دادههای انسانی و تنها با خودآموزی به سطحی بالاتر از آلفاگو اصلی رسید.

چگونه آلفاگو از یادگیری عمیق برای پیروزی استفاده کرد؟

آلفاگو از یادگیری عمیق برای تحلیل موقعیتهای بازی و پیشبینی حرکات بهینه استفاده کرد. شبکه سیاست، که با دادههای 30 میلیون حرکت انسانی آموزش دیده بود، به آلفاگو کمک کرد تا حرکات محتمل را شناسایی کند. شبکه ارزش، با ارزیابی احتمال پیروزی در هر موقعیت، به سیستم امکان داد تا تصمیمات استراتژیک بگیرد. این دو شبکه با جستجوی درخت مونتکارلو ترکیب شدند تا آلفاگو بتواند در میان تعداد عظیم حالات ممکن، بهترین مسیر را انتخاب کند. این ترکیب، بهویژه در حرکت معروف شماره 37 در بازی دوم مقابل لی سدول، خلاقیت بیسابقهای را نشان داد که حتی حرفهایها را شگفتزده کرد.

استفاده از شبکههای عصبی کانولوشنی (CNN)

شبکههای عصبی کانولوشنی (Convolutional Neural Networks – CNN) در قلب یادگیری عمیق آلفاگو قرار داشتند. این شبکهها برای تحلیل الگوهای بصری روی تخته گو طراحی شدند، مشابه با پردازش تصاویر در بینایی کامپیوتری. شبکه سیاست از CNN برای پیشبینی حرکات احتمالی استفاده کرد، در حالی که شبکه ارزش از CNN برای ارزیابی موقعیتهای بازی بهره برد. این شبکهها با لایههای متعدد، الگوهای پیچیدهای را از دادههای خام استخراج کردند و به آلفاگو امکان دادند تا تصمیماتی مشابه شهود انسانی بگیرد. استفاده از CNN، کارایی محاسباتی آلفاگو را بهبود بخشید و آن را از روشهای سنتی متمایز کرد.

جستجوی درخت مونتکارلو در تصمیمگیری آلفاگو

جستجوی درخت مونتکارلو (MCTS) الگوریتمی بود که آلفاگو برای انتخاب بهترین حرکت در میان تعداد عظیم حالات ممکن استفاده کرد. MCTS با شبیهسازی بازیهای تصادفی از هر موقعیت، احتمال پیروزی هر حرکت را ارزیابی میکرد. این الگوریتم با هدایت شبکه سیاست، روی حرکات محتملتر تمرکز میکرد و با استفاده از شبکه ارزش، نتایج شبیهسازیها را بهبود میبخشید. این ترکیب، آلفاگو را قادر ساخت تا بهصورت کارآمد در فضای جستجوی عظیم گو حرکت کند و تصمیمات استراتژیک بگیرد که حتی بازیکنان حرفهای را شگفتزده کرد.

تمرین با دادههای انسانی و خودیادگیری

آلفاگو در مراحل اولیه با دادههای 30 میلیون حرکت از بازیهای انسانی آموزش دید تا الگوهای اولیه بازی را یاد بگیرد. این دادهها به شبکههای عصبی کمک کردند تا حرکات محتمل و موقعیتهای برنده را شناسایی کنند. پس از این مرحله، آلفاگو با یادگیری تقویتی و بازی مقابل نسخههای مختلف خود، استراتژیهای جدیدی ابداع کرد. در نسخه آلفاگو زیرو، این وابستگی به دادههای انسانی حذف شد و سیستم تنها با خودآموزی و از صفر شروع کرد. این رویکرد خودیادگیری به آلفاگو زیرو امکان داد تا در عرض سه روز از آلفاگو اصلی پیشی بگیرد.

پیروزی آلفاگو بر لی سدول: نقطه عطف تاریخ AI

مسابقه آلفاگو مقابل لی سدول در مارس 2016 در سئول، کره جنوبی، نقطه عطفی در تاریخ هوش مصنوعی بود. این مسابقه که بیش از 200 میلیون نفر در سراسر جهان آن را تماشا کردند، شامل پنج بازی بود که آلفاگو چهار بازی را برد. در بازی دوم، حرکت شماره 37 آلفاگو، که با احتمال 1 در 10,000 انتخاب شد، چنان خلاقانه بود که لی سدول را شوکه کرد و دیدگاههای سنتی در مورد گو را به چالش کشید. لی سدول در بازی چهارم با حرکت شماره 78 (معروف به “لمس خدا”) پیروز شد، اما آلفاگو در بازی پنجم به پیروزی نهایی دست یافت.

بازیهای آلفاگو مقابل لی سدول و کی جیه شامل لحظات تاریخی بودند. حرکت شماره 37 در بازی دوم مقابل لی سدول، که روی شانه پنجم قرار گرفت، برخلاف استراتژیهای سنتی بود و به آلفاگو برتری داد. در بازی چهارم، حرکت شماره 78 لی سدول، که بهعنوان یک حرکت خلاقانه و غیرمنتظره شناخته شد، نشان داد که انسانها هنوز میتوانند هوش مصنوعی را به چالش بکشند. در مسابقه مقابل کی جیه در سال 2017، آلفاگو مستر با استراتژیهای پایدار و بدون خطا، برتری کامل خود را نشان داد. این بازیها الهامبخش بازیکنان در سراسر جهان برای بازنگری در استراتژیهای گو شدند.

روند تکاملی آلفاگو تا نسخههای پیشرفتهتر

آلفاگو پس از پیروزی مقابل لی سدول تکامل یافت. در سال 2016-2017، آلفاگو مستر در 60 بازی آنلاین با نتیجه 60 بر 0 مقابل بازیکنان برتر جهان، از جمله کی جیه، پیروز شد. در سال 2017، آلفاگو زیرو معرفی شد که بدون استفاده از دادههای انسانی و تنها با خودآموزی، در عرض سه روز از آلفاگو اصلی پیشی گرفت. آلفاگو زیرو سپس به آلفازرو (AlphaZero) تکامل یافت که توانایی بازی در شطرنج و شوگی را نیز داشت. موزرو (MuZero)، نسخه بعدی، بدون نیاز به دانستن قوانین بازی، توانایی یادگیری از صفر را نشان داد. این روند تکاملی، پتانسیل یادگیری تقویتی را به نمایش گذاشت.

وضعیت فعلی پروژه آلفاگو گوگل AlphaGo

پس از پیروزی مقابل کی جیه در سال 2017، دیپمایند آلفاگو را از رقابتهای رسمی بازنشسته کرد تا تمرکز خود را بر کاربردهای عملیتر مانند پزشکی، علوم مواد، و مدلسازی آبوهوا معطوف کند. فناوریهای توسعهیافته در آلفاگو، بهویژه یادگیری تقویتی و شبکههای عصبی، در پروژههایی مانند آلفافولد (AlphaFold) برای حل مسائل تاشدگی پروتئین استفاده شدند. اگرچه آلفاگو دیگر در رقابتهای گو فعال نیست، میراث آن در پیشرفتهای هوش مصنوعی و الهامبخشی به محققان ادامه دارد.